啊太深了原视频曝光竟是AI换脸伪造技术成果

最新消息:一项针对视频伪造技术的识别工具已进入测试阶段,有望帮助用户快速分辨真假视频。🛡️

“啊太深了原视频曝光竟是人工智能换脸伪造技术成果”——这句在网络上疯传的话,揭示了人工智能换脸技术强大的伪造能力及其潜在的社会风险。它引发了公众对真相的焦虑,也促使我们更深入地思考技术发展带来的伦理挑战。

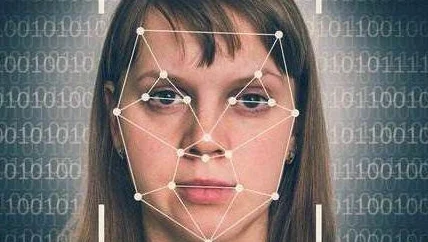

以“脸”示人:技术进步与信任危机

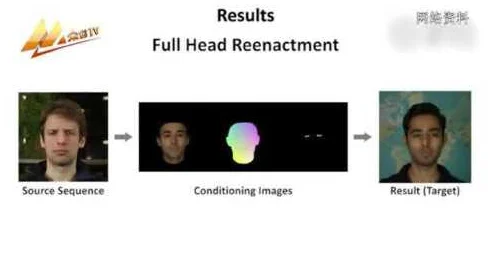

换脸技术,学术上称为“面部重演”,其核心是利用深度学习算法将一个人的面部特征替换到另一个人的视频或图像中。这项技术最初应用于影视娱乐领域,例如电影特效制作,但随着技术的普及和门槛的降低,它逐渐被滥用于制作虚假信息、色情内容,甚至进行诈骗活动。 一些研究表明,人工智能生成的虚假视频比传统的伪造视频更难以识别,这无疑加剧了公众对信息真实性的担忧。正如斯坦福大学的研究人员所说,“深度伪造技术对社会信任构成了根本性挑战”。网友评论也印证了这一点:“现在看到视频都不敢相信是真的了”,“感觉眼见也不一定为实”。

拨开迷雾:技术识别与伦理反思

面对换脸技术带来的挑战,技术界也在积极探索应对之策。例如,一些研究机构正在开发能够识别伪造视频的算法,通过分析视频中的微表情、光线变化等细节来判断其真伪。同时,区块链技术也被认为是维护信息真实性的有效手段,它可以记录视频的来源和修改历史,从而提高信息的透明度和可溯源性。

除了技术手段,伦理反思也至关重要。我们需要思考如何规范换脸技术的应用,如何平衡技术创新与社会安全,如何建立更加健全的法律法规来打击滥用行为。一些网友呼吁加强对换脸技术的监管,并提高公众的媒介素养,增强对虚假信息的辨别能力。“技术本身没有好坏,关键在于如何使用”,一位网友的评论得到了广泛认同。推荐大家关注一些科普平台,学习辨别伪造视频的技巧,提高自身的防范意识。

守护真相:多方合力共筑安全网络

打击换脸技术滥用,需要政府、企业、公众等多方共同努力。政府应加强立法和监管,明确换脸技术的应用边界,严厉打击违法犯罪行为;企业应加强技术研发,开发更有效的识别和防范工具;公众则应提高警惕,增强辨别能力,不轻易传播未经证实的信息。只有形成合力,才能构建一个更加安全、可信的网络环境。

问题与解答:

- 如何识别换脸视频?

答:可以关注视频中人物的微表情、光线变化、边缘衔接等细节,如果发现异常,则需提高警惕。此外,还可以借助一些专业的识别工具来辅助判断。

- 换脸技术有哪些积极的应用?

答:换脸技术在影视娱乐、医疗健康等领域具有积极的应用前景。例如,它可以用于电影特效制作、虚拟角色扮演、面部重建等。

- 如何防范换脸技术带来的风险?

答:除了提高自身的辨别能力外,还可以关注官方发布的信息,不轻易相信和传播未经证实的消息。同时,也要注意保护个人信息,避免被用于制作虚假视频。

相关内容:

深度学习技术的快速发展为换脸技术的实现提供了强大的技术支撑。生成对抗网络(GAN)是其中一种关键技术,它通过生成器和判别器之间的对抗训练,不断提高生成图像的逼真度。

参考的资料与论文名字:

- Goodfellow, I. J., Pouget-Abadie, J., Mirza, M., Xu, B., Warde-Farley, D., Ozair, S., ... & Bengio, Y. (2014). Generative adversarial networks. Communications of the ACM, 63(11), 139-144.

- Korshunov, P., & Marcel, S. (2018). Deepfakes: a new threat to face recognition? assessment and detection. arXiv preprint arXiv:1812.08798.